扫描分享

本文共字,预计阅读时间。

1

2016年某天,麻省理工学院(MIT)的研究生乔伊·布兰维尼(Joy Buolamwini)和电脑人脸识别软件玩起了躲猫猫游戏,先用手把脸遮住,然后放开,来看软件的识别能力。可她发现,电脑根本就识别不了她的脸,她戴上白色面具后,果然,更容易识别了。

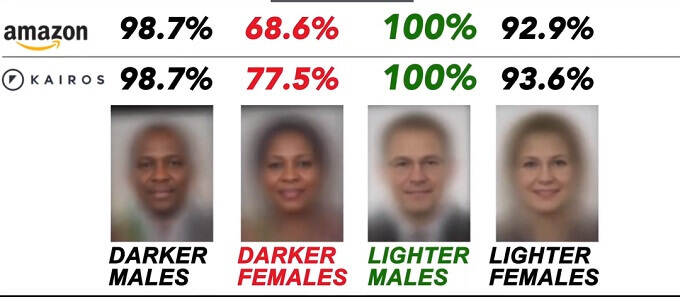

后来的种种证据表明,她无法被识别的原因是,人脸识别技术背后的编码是由白人男性写出来的。它们的成功率首先最利于白人男性、其次是白人女性,再是黑人。

不久后,她又在香港参加了一个创业比赛,赛后参观一个创业公司在和一款社交机器人交流时,发现那款机器人也无法识别她的脸,一问,才知道,这款机器人和她之前玩躲猫猫游戏时使用的是同一款人脸识别软件。

乔伊意识到,算法偏见传播得如此之快,即使在地球的另一边,只需要从互联网上下载一个软件,算法偏见就可以完成对一个种族的全球“围剿”。

这种偏见,不光是“无法识别”。在美国的政府、警察部门所应用的人脸识别技术里,黑人被经过算法计算后的摄像头认定为犯罪分子的可能性,要远大于白人。

这年11月,乔伊创办了一个叫“算法正义联盟(Algorithmic Justice League)”的公司,来对抗算法偏见。

乔伊断定,要创造更具有包容性的代码,并且运用有包容性的编程实践,就要从人开始。由谁来编程很重要。

言下之意,什么样的地位决定你写代码时的意识形态。

图:乔伊·布兰维尼(Joy Buolamwini)和“算法正义联盟”AJL;来源:纪录片《编码歧视》截图。

实际上这种代码权力是被谁把控的呢?

2018年,谷歌日前首次发布关于公司雇员的多样性报告,其中全球范围内女性员工占比30.9%。而在美国工作的员工中,黑人占比2.5%,拉丁裔占比3.6%,印第安裔占比0.3%,而其他种族员工占比4.2%。

2020年7月,Facebook的一名黑人员工当地时间周四提出了一项指控,Facebook在招聘、绩效评估、晋升和薪酬方面表现出对黑人员工的歧视,黑人工人只占该公司技术职位的1.5%。

类似的例子在微软、亚马逊等大公司也差不多。在编程时,不同的人群有意识或潜意识的将自己的意识形态和偏见代入到了算法模型中。

“算法就像病毒一样会以飞快的速度大范围地扩散偏见”。乔伊说。

图:亚马逊的脸部识别技术在不同人种中的有效率,来源:纪录片《编码歧视》截图

2

在《技术垄断》一书里,法院、学校、家庭三者是被尼克波斯曼认为防范技术垄断文化带来的信息泛滥的三大防线,这三个防线决定什么信息可以进入它们,比如,学校决定教学生什么、法院决定哪些信息可以作为法官或陪审团的参考意见、证据,家庭准许或杜绝孩子看什么漫画书、电子产品。

如今这一防线正在被算法从内部攻破。

根据网站Propublica的研究,人工智能软件在美国被用来预测犯罪,算法更容易把黑人罪犯识别为高风险可能再犯罪的人,白人罪犯则识别为低风险。

乔伊还发现,为了实现警情预测,执法机构也开始使用起机器学习,一些法官使用机器生成的危险评分来决定囚犯要在监狱里呆多久。

2020年开始的新冠疫情期间,美国爆发了大量的抗议活动,而美国地方、州、联邦警察以及毒品管制局(DEA)、海关和边境保护局(CBP)、移民和海关执法局(ICE)等机构和各种美军正在部署广泛的监控技术,用来收集、分享和分析抗议者的信息。

信息假借算法之手,正在攻破人们对技术垄断文化的防线。我们防范了信息泛滥,却没防住算法精心编排的偏见。

透过手机那块小小的显示屏,算法轻而易举的从人们脑中驱逐了几百年以来的根深蒂固的黑格尔、尼采、康德。

3

2019年5月,美国众议院监督和改革委员会第一次召开了针对脸部识别技术的听证会,研究面部识别技术如何影响公民权利、歧视少数族裔。包括算法正义联盟创始人Joy Buolamwini在内的许多人均作了证词,他们说:

“这些工具太强大了 ,而且很明显存在严重的缺陷,比如极端的人口统计和表型偏见。我们不会允许政府机构使用这些工具,不会让政府基于这些工具的分析结果做决定,然后未来再想办法避免这些工具被误用或滥用。”

2020年一天,一个黑人在英国伦敦的街上被摄像头的人脸识别技术判定为疑似罪犯,随后几个便衣警察拦了他,采集了他的指纹,对照了罪犯库资料后,发现并不相符后又放了他。

这时,伦敦一个叫“Big Brother Watch”(“老大哥观察”)的组织正走向街头,他们鼓励这位黑人和发动有类似遭遇的人们反对人脸识别技术的应用。

图:Big Brother Watch组织的工作人员在发传单鼓励人们反抗算法偏见;来源:纪录片《编码歧视》截图

“Big Brother Watch”名字来自于奥威尔小说《1984》那句著名的“Big Brother Is Watching You”,Big Brother 意为独裁者。这个机构担心的就是:我们必须十分警惕人工智能掌握的权力走向独裁主义。

在乔伊的算法正义联盟和Big Brother Watch等类似的机构抗争下,对抗面部识别技术算法偏见的运动取得了一些成绩。

比如,2019年,旧金山成为首个禁止政府使用面部识别技术的城市,之后,奥克兰和伯克利宣布禁止。

2020年6月,IBM宣布退出面部识别项目,停止研究、停止提供服务和停止销售。IBM首席执行官Arvind Krishna呼吁美国国会颁布改革措施,以推进种族公正、反对系统化的种族歧视。

图:Big Brother Watch组织;来源:纪录片《编码歧视》截图。

4

人脸识别技术只是算法应用的一个方面而已,在更多领域,算法的偏见正在操纵生活的方方面面。

数据科学家凯西·欧奈尔在她《算法霸权——数学杀伤性武器的威胁》一书中,阐述了逐渐严重的“新型大规模杀伤性武器”,即“广泛应用而又神秘的、具有破坏性的算法”,正在被越来越多地运用于决策制定上,而这些决策影响着我们生活的方方面面。

比如贷款审核的算法。

许多金融科技机构正在用学历、户籍、种族等一切信息轻易地给你更高的贷款利率甚至拒绝你的贷款。

《从业经历和教育背景是否能提高借贷成功率?》一文曾证实学历在网贷中的正相关因素,它指出,教育程度在1%的显著水平上与借贷成功率呈正相关关系。此外,性别、领域对借款能否成功产生影响。

中国央行研究局前局长徐忠曾表示,如果将客户个人信息用于信用评估时,可能影响信贷的公平性,有一些指标比如性别、地域、职业等可能对客户的还款能力有解释力,但根据这些指标进行放贷,会涉及到对某些人群的歧视。

但在算法的决策黑箱里,这些都看不见。

一家借贷平台在他的大数据风控的系统中输入一个人用户数以千计的社交数据、搜索数据、浏览数据、交易数据等,经过深度学习和决策模型的计算,最终可能将一个人的信用定为不及格,但这其中的具体决策过程是什么,企业不会告知你。

更甚至于,这个决策过程中出现程序错误、算法歧视时,电脑试图向程序员解释时,程序员也无法明白。

哥伦比亚大学的机器人学家 Hod Lipson曾说:“这就像是向一条狗解释莎士比亚是谁。”

过去几十年,美国民间与政府的博弈过程中,进步人士曾试图要求像谷歌、微软等大公司公布其人工智能决策的逻辑与原理,最后都被后者以“商业保密”借口驳回。

人脸识别技术;来源:纪录片《编码歧视》截图。

5

帕斯奎尔在《黑箱社会:控制金钱和信息的法则》揭露了一种“技术黑箱”。

所谓技术黑箱,实际上是一种无法识别算法逻辑的机制。如果人们把人类的偏见通过数据强加给算法,算法就会继承偏见和意识形态。

如果将算法视为一种工具,那这种工具就是麦克卢汉所认为的:每一种工具里都嵌入了意识形态偏向,它们决定了这种工具用一种方式而不是用另一种方式构建世界的倾向。

算法评价模型怎样反作用于人类社会?

最早的大学排名来自一家美国报纸,知名度逐渐推广后,导致大学依据这排名的评定标准修改教学规则。后来沙特阿拉伯的一所大学,用虚假手段获得排名,比如聘请知名学者作为教授以满足排名标准的影响力准则。这种数据继而再次错误的反馈给算法模型,导致算法更荒谬,模型更为失真,致使其他大学再根据这种荒谬性去整改自己,整个大学教育体制愈加趋于崩塌。

《算法霸权》凯西·欧奈尔将算法总结为,算法是简单的通过历史数据对未来进行预测,她提出了担心编码权力的三大问题:

谁掌握了AI编码的终极权力?归根结底是谁真正拥有这些编码?拥有编码的人如何将编码施加于其他人身上?

在互联网世界,可以说马克扎克伯格是权力最大的人,他可以傲视26亿用户,Facebook可以用算法在广告中歧视网民,但人们没有申诉渠道,也无法追责。推特和facebook甚至可以封掉时任美国总统特朗普的网络账号。

如今,人工智能假借的载体,如美国和英国等国家政府、警方对人脸识别技术在监控系统上的应用,打破了以往的法律体系,它们没有依据任何法律条文,也没有获得认可法律许可。更没有对这些应用的监管体系。

纪录片《编码歧视》中一位受访者称:未来已来,只不过分布不均。一批富有的人掌握了技术,而将这种最具惩罚性、侵略性、基于算法的监控的工具:人脸识别,在另一批底层群体中测试,实施。

小心了,老大哥在看着你!

参考资料:

纪录片《编码歧视》 导演: 莎里妮·坎塔雅 2020

《How I'm fighting bias in algorithms 》 TED 2019.01

《人工智能的种族主义源于算法,若现在不解决未来将更难》 36氪 2017.04

《来自算法正义联盟的信:与面部监控技术的斗争刻不容缓!》 公众号“读芯术”,2020.06

非常感谢您的报名,请您扫描下方二维码进入沙龙分享群。

非常感谢您的报名,请您点击下方链接保存课件。

点击下载金融科技大讲堂课件本文系未央网专栏作者发表,属作者个人观点,不代表网站观点,未经许可严禁转载,违者必究!首图来自图虫创意。

本文为作者授权未央网发表,属作者个人观点,不代表网站观点,未经许可严禁转载,违者必究!首图来自图虫创意。

本文版权归原作者所有,如有侵权,请联系删除。首图来自图虫创意。

京公网安备 11010802035947号

京公网安备 11010802035947号