扫描分享

本文共字,预计阅读时间。

随着人工智能技术的飞速发展,生成式AI正逐渐渗透到我们的日常生活和各行各业中。从文本创作到艺术设计,从虚拟助手到智能客服,AI的身影无处不在。然而,技术的创新与应用,离不开法律的规范与引导。为进一步保障和监管AI技术创新,我国出台了《生成式人工智能服务管理暂行办法》(以下简称《办法》),为AI技术的合规应用提供了明确的法律框架。此前,我国已经出台了针对深度合成算法的《互联网信息服务深度合成管理规定》(以下简称《深度合成规定》),明确了深度合成服务相关方的义务与主体责任。《办法》和《深度合成规定》构建了针对大模型的“双备案系统”,即“深度合成算法备案”和“大模型备案”。

今年4月,我国又颁布了一批已备案的生成式人工智能服务信息,这标志着对AI服务管理的进一步加强。本文将深入解析《办法》的核心要点,探讨大模型(生成式人工智能)备案的合规,帮助企业与开发者在享受AI技术红利的同时,确保每一步都符合法律规范,共同推动人工智能行业的稳健前行。

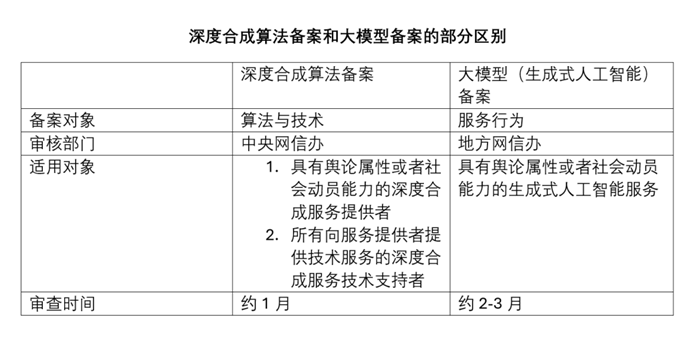

01 大模型备案VS算法备案

在此之前,我们先简单讨论以下大模型备案和算法备案的异同。根据《深度合成规定》,深度合成技术是指利用深度学习、虚拟现实等生成合成类算法制作文本、图像、音频、视频、虚拟场景等网络信息的技术,包括但不限于文字生成、音乐生成、文字转语音等。而深度合成算法备案是对服务提供商所开发或者拥有的该技术算法进行备案。同一种算法只需要备案一次。

《办法》指出,具有舆论属性或者社会动员能力的深度合成服务提供者,应当按照《互联网信息服务算法推荐管理规定》,通过当地的网信部门,履行备案和变更、注销备案手续。

对于大模型服务提供商来说,因为大部分大模型服务中使用了深度合成技术,完成深度合成算法的备案一般也需要完成大模型备案;反之则不然,若某项大模型技术使用的是已经备案的算法或接口,则不需要提供深度合成算法备案。当然,如果一个大模型服务使用了多种未备案的深度合成算法,则需要对每一个算法进行备案。

02 备案的生成式AI(大模型)要求

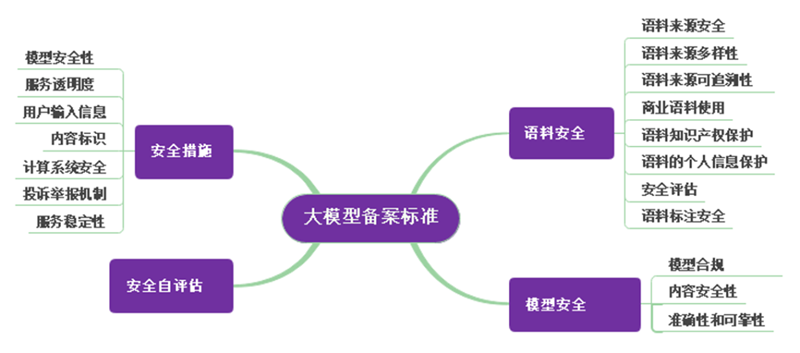

为达到备案标准,服务提供商需要根据《生成式人工智能服务安全基本要求》(以下简称为《要求》)提供以下材料:语料安全、模型安全、安全措施,以及以上的安全自评估。各个板块的重点审查内容如下图所示。

1. 语料安全

语料安全确保了大模型训练时使用的数据合规、安全。语料安全的板块涵盖以下内容:

- 语料来源安全:对于特定语料来源,提供者在采集前后都应进行安全评估;含违法不良信息超过5%的语料不应采集或使用,且不应使用违反我国网络安全相关法律法规要求阻断的信息作为训练语料。

- 语料来源多样性:应提高语料来源的多样性,确保每种语言和类型的语料都来自多个来源,并合理搭配境内外来源语料。

- 语料来源可追溯性:使用开源语料时应具有相应的开源授权协议或文件,使用自采语料时应有采集记录,并且避免采集明确不可采集的语料。

- 商业语料使用:使用商业语料时,应有法律效力的交易合同或合作协议,并应对交易方或合作方提供的语料、承诺、材料进行审核。

- 语料知识产权保护:应设置知识产权负责人,建立管理策略,对语料中的知识产权侵权风险进行识别,不应使用有侵权问题的语料进行训练。

- 语料的个人信息保护:使用包含个人信息的语料时,应获得个人信息主体的授权同意,或满足其他合法使用条件。

- 安全评估:提供者对语料安全情况进行评估时,应采用人工抽检、关键词、分类模型等方法,确保抽样合格率达到规定标准。

- 语料标注安全:应对标注人员进行安全培训、考核、划分,并指定标注的规则。同时应当对标注语料进行抽检。

2. 模型安全

模型安全是为了确保生成式人工智能大模型产品在提供服务时所生成的内容的安全、准确、合法,同时保护知识产权和用户隐私。

- 模型合规:如需基于第三方基础模型提供服务,应使用已经主管部门备案的基础型。

- 内容安全性:训练时优先考虑生成内容的安全性,并引导模型产出积极内容。

- 准确性和可靠性:提高生成内容中数据及表述与科学常识及主流认知的符合程度,减少其中的错误内容,并提高生成内容对使用者的帮助作用。

3. 安全措施

建立全面的安全管理体系,包括合规性、风险控制、透明度、用户控制、未成年人保护、响应机制和系统安全性,以促进生成式人工智能服务的健康发展并保护用户权益。

- 模型安全性:使用经备案的模型,并对关键场合,例如金融、医疗信心、基础设施的风险保护措施,和未成年人使用场景实施额外保护。

- 服务透明度:公开服务信息、模型算法概要、个人信息用途;显著位置展示,易于用户访问。

- 用户输入信息:提供便捷方式让用户关闭信息训练功能;显著告知信息收集状态和关闭选项。

- 内容标识:确保图片、视频等内容标识符合国家标准。

- 计算系统安全:评估供应链安全,芯片支持硬件安全启动,保障系统安全运行。

- 投诉举报机制:提供投诉举报途径,明确处理规则和时限。

- 服务稳定性:隔离训练与推理环境,防范攻击;定期安全审计,建立备份和恢复策略。

03 写在最后

此外,《要求》还提出了一些其他条件,包括但不限于:

- 关键词库量不少于10000个,且具有代表性,每周最好至少按照网络需要更新一次词库。

- 建立完整的生成内容测试题库,总规模不少于20000题,且具有代表性。

- 建立完整的拒答测试题库,包含应拒答题库和非拒答题库各500题等等。

随着《生成式人工智能服务管理暂行办法》的实施,大模型备案所涉及到一系列相对复杂的流程与合规问题,对很多行业内的个体经营者提出了新领域的挑战。合规不仅是企业与开发者的责任,更是推动整个行业健康、有序发展的关键。在享受AI技术带来的便利和红利的同时,我们必须时刻保持警醒,确保每一步操作都在法律的框架之内。最后,如各位老友有任何AI领域的法律及合规问题,也随时欢迎来与飒姐共同探讨!

非常感谢您的报名,请您扫描下方二维码进入沙龙分享群。

非常感谢您的报名,请您点击下方链接保存课件。

点击下载金融科技大讲堂课件本文系未央网专栏作者发表,属作者个人观点,不代表网站观点,未经许可严禁转载,违者必究!首图来自图虫创意。

本文为作者授权未央网发表,属作者个人观点,不代表网站观点,未经许可严禁转载,违者必究!首图来自图虫创意。

本文版权归原作者所有,如有侵权,请联系删除。首图来自图虫创意。

京公网安备 11010802035947号

京公网安备 11010802035947号